아마존이 세레브라스의 추론 전용 칩을 서비스에 도입한다. 하이퍼스케일러 중에서 이를 채택한 것은 처음으로, 늘어나는 추론 수요에 대응하려는 것이다.

아마존웹서비스(AWS)는 13일(현지시간) 자체 AI 칩과 세레브라스 칩을 결합한 새로운 AI 인프라 서비스를 2026년 하반기부터 제공할 계획이라고 발표했다.

이번 협력은 사용자 질문에 AI가 답을 생성하는 추론(inference) 작업을 빠르게 처리하기 위한 것이다. 아마존의 '트레이니엄(Trainium) 3' 칩이 사용자 입력을 처리하는 프리필(prefill) 단계에서 역할을 맡고, 이후 세레브라스의 'WSE(Wafer Scale Engine)' 칩이 실제 답변을 생성하는 디코드(decode) 단계에서 연산을 수행한다.

이 같은 방식은 작업을 두 단계로 나누는, 이른바 '분산 처리(disaggregated computing)' 전략이다. 일반적으로 서로 다른 칩 간 통신은 처리 속도를 떨어뜨릴 수 있지만, 양사는 각 작업에 특화된 칩을 사용함으로써 이를 보완할 수 있다고 설명했다.

나페아 브샤라 AWS 부사장은 "트레이니엄 칩만 사용하는 서비스가 비용 측면에서는 더 저렴할 수 있지만, 속도가 중요한 작업에서는 이번 조합이 매력적인 선택지가 될 것"이라고 말했다.

이번 협력은 기업공개(IPO)를 준비 중인 세레브라스에도 중요한 의미가 있다. AWS가 세레브라스 칩을 채택한 첫 번째 하이퍼스케일러이기 때문이다.

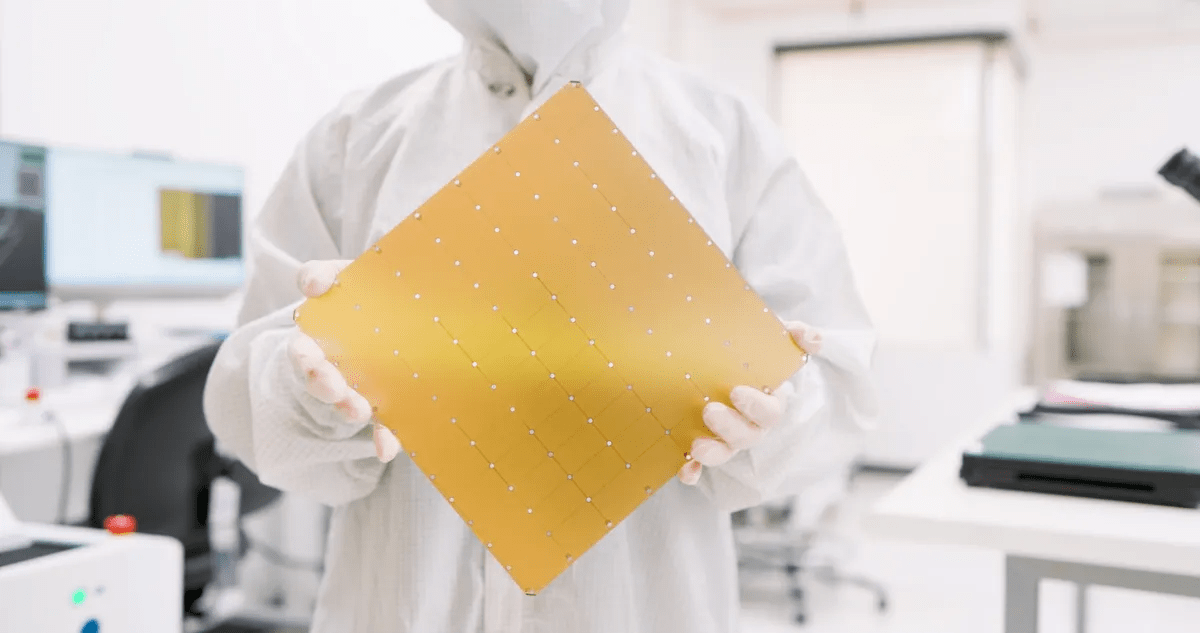

세레브라스는 초대형 단일 칩 구조를 기반으로 하는 독특한 AI 칩 설계를 통해 시장을 선도하는 엔비디아에 도전하고 있다. 기존 GPU와 달리 값비싼 고대역폭 메모리(HBM)에 크게 의존하지 않는 방식의 AI 칩 구조를 개발했다. 지난 1월에는 오픈AI와 750메가와트(MW) 규모의 컴퓨팅 파워를 확보하는 다년 계약을 맺기도 했다.

앤드류 펠드먼 세레브라스 CEO는 "AWS의 막대한 고객 기반을 통해 가장 빠른 AI 추론 성능을 훨씬 더 많은 사용자에게 제공할 수 있게 됐다"고 말했다.

아마존은 여전히 엔비디아의 GPU에 주로 의존하지만, 동시에 자체 AI 칩 개발에도 적극 투자하고 있다. 이는 데이터센터 운영 비용을 낮추고 차별화된 클라우드 서비스를 제공하기 위한 전략이다.

박찬 기자 cpark@aitimes.com

<저작권자 copyright ⓒ ai타임스 무단전재 및 재배포 금지>