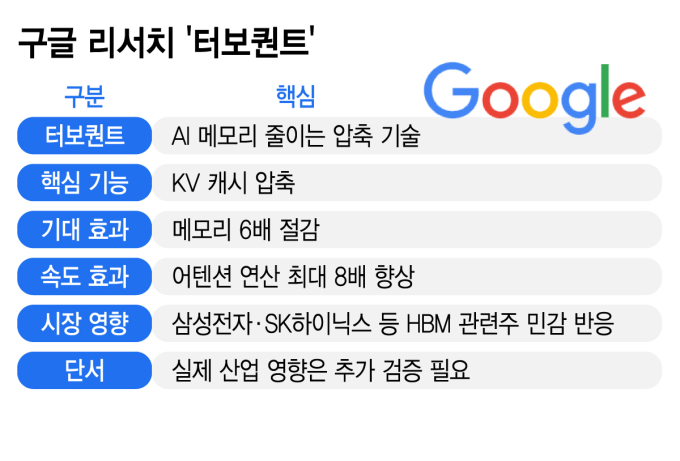

구글이 생성형 AI의 메모리 부담을 크게 낮출 수 있는 압축 기술 '터보퀀트(TurboQuant)'를 공개했다. 대형언어모델(LLM)이 답변 과정에서 임시 저장하는 'KV 캐시'를 더 작게 압축하면서도 정확도 저하를 최소화하는 기술이다. 시장에서는 고대역폭메모리(HBM) 수요 구조를 바꿀 변수로 해석하며 삼성전자와 SK하이닉스 등 반도체주에도 촉각을 곤두세우고 있다.

26일 IT(정보기술) 업계에 따르면 구글 리서치는 지난 24일 관련 기술을 공개했고, 해당 연구는 머신러닝 분야 주요 학술대회인 ICLR 2026 발표 목록에도 이름을 올렸다. ICLR은 '국제 표현학습 학회(International Conference on Learning Representations)'로, 딥러닝과 머신러닝 분야 대표 학회 중 하나로 꼽힌다.

터보퀀트는 쉽게 말해 AI를 '더 가볍게' 돌리게 해주는 기술이다. AI 챗봇은 답변을 만들 때 앞서 주고받은 문맥을 계속 참고해야 한다. 이때 이전 정보를 잠시 저장해두는 공간이 KV 캐시다. 계산 중간에 메모를 적어두는 메모장과 비슷하다. 대화가 길어질수록 이 공간이 빠르게 커지고, 결국 GPU 메모리와 서비스 운영 비용 부담도 함께 커진다. 구글은 터보퀀트를 이런 병목을 줄이기 위한 고압축 양자화 알고리즘으로 설명했다.

구글의 공식 설명에 따르면 터보퀀트는 KV 캐시 메모리 사용량을 최소 6배 줄일 수 있다. 또 엔비디아 H100 GPU 환경에서 어텐션 연산 속도를 최대 8배 높일 수 있다. '8배'는 AI 전체 추론 속도가 아니라 어텐션 연산 구간 기준이다. 실제 서비스 전체 응답 속도 향상은 이보다 낮을 수 있다.

기술 실효성은 아직 검증이 더 필요하다. 공개 자료상 터보퀀트는 연구 성과 단계에 가깝다. 증권시장은 이 기술이 메모리 사용량 자체를 줄일 수 있다는 점에 먼저 반응했지만, 초대형 모델 전반에서 같은 수준의 효과가 재현되는지는 추가 검증이 필요하다. 지금 단계에서는 상용 서비스 전반의 수요 구조를 단정하기보다 추론 효율 개선 가능성에 주목하는 편이 더 정확하다.

삼성전자와 SK하이닉스가 함께 거론된 것도 이 때문이다. 두 회사는 AI 서버에 들어가는 D램과 HBM의 핵심 공급사다. 시장에서는 터보퀀트 같은 압축 기술이 확산되면 장기적으로 AI 인프라에 필요한 메모리 탑재량이 줄 수 있다는 해석이 나왔다. 실제로 지난 25일(현지시간) 미국 시장에서는 마이크론 등 메모리주가 약세를 보였다. 이날 국내 증시에서도 삼성전자와 SK하이닉스가 나란히 하락하며 관련 우려가 반영됐다.

다만 이를 곧바로 삼성전자와 SK하이닉스의 펀더멘털 악화로 연결하기는 이르다. 터보퀀트는 메모리 사용 효율을 높이는 기술이다. AI 수요 자체를 줄이는 기술은 아니다. 같은 장비로 더 많은 AI 서비스를 운영할 수 있게 되면 오히려 AI 도입이 더 빨라져 전체 메모리 수요가 커질 가능성도 있다. 실제 시장에서도 미국 메모리주의 급락을 두고 '논문 한 편에 대한 과도한 해석'이라는 시각이 함께 나온다. 실제 영향은 상용화 속도와 적용 범위를 더 지켜봐야 한다는 평가다.

김평화 기자 peace@mt.co.kr

Copyright ⓒ 머니투데이 & mt.co.kr. 무단 전재 및 재배포, AI학습 이용 금지.