삼성전자가 엔비디아의 새로운 인공지능(AI) 추론 칩을 생산한다. AI 시장이 학습 기반 대규모언어모델(LLM) 개발에서 에이전틱 AI로 전환하면서 추론 칩이 각광받는 가운데 삼성전자가 고대역폭메모리(HBM) 공급에 이어 추론 칩 위탁 생산까지 맡으면서 엔비디아와의 협력 관계를 더 공고히 할 수 있게 됐다.

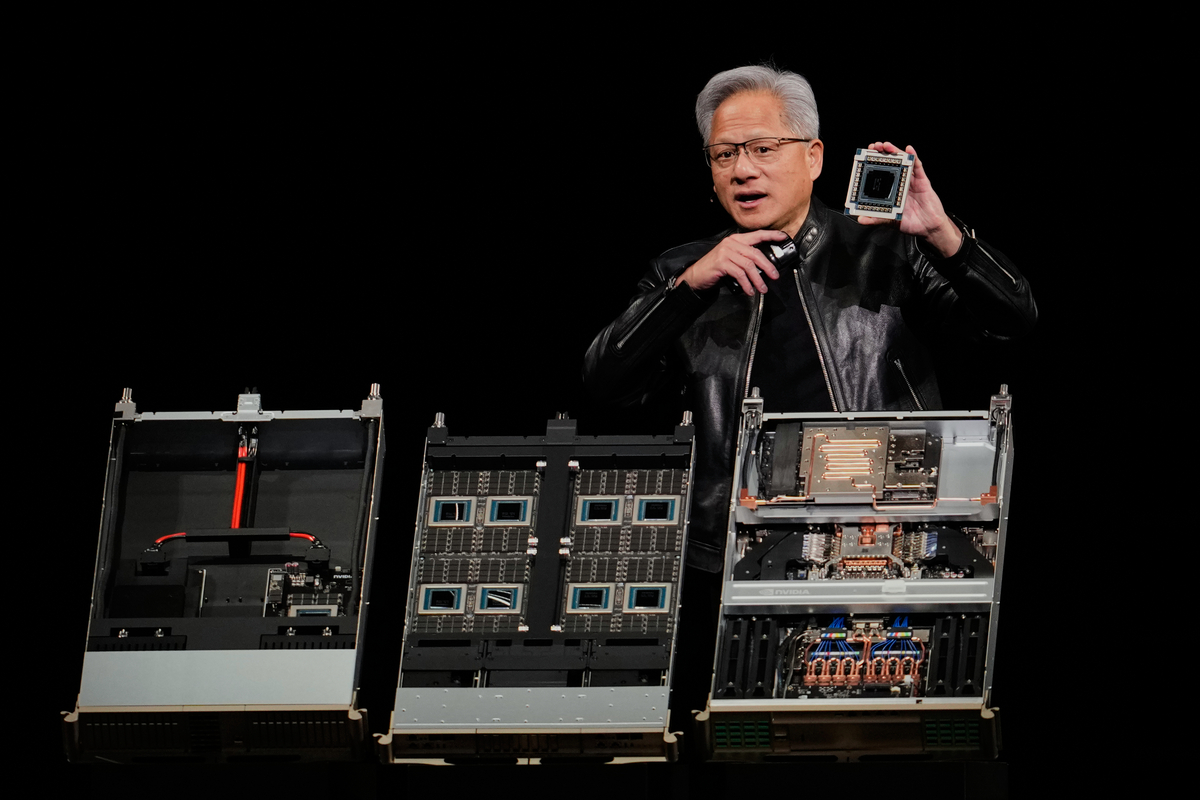

젠슨 황 엔비디아 최고경영자(CEO)는 16일(현지 시간) 개막한 ‘GTC 2026’에서 새 추론 언어처리장치(LPU) 칩인 ‘그록 3 LPU’를 공개하면서 삼성전자가 생산을 맡는다고 밝혔다. 출하 시기는 올해 3분기로 계획됐다.

황 CEO는 삼성전자가 최신 AI 가속기인 ‘베라 루빈’에 들어가는 최신 HBM ‘HBM4’ 공급과 함께 LPU 제조까지 맡게 된 점을 소개하면서 감사 뜻을 전했다. 그는 “베라 루빈을 포함해 우리를 위해 그록 3 LPU 생산을 맡아준 삼성에 고맙다고 말하고 싶다”며 “그들은 최선을 다하고 있다. 정말 고맙다”고 강조했다.

엔비디아는 올해 하반기 출시할 베라 루빈에 추론 LPU를 탑재해 성능을 극대화한다는 구상이다. 추론용 칩은 엔비디아가 창립 역대 최대인 200억 달러(30조 원)에 그록을 우회 인수한 이후 내놓는 첫 제품이다. 엔비디아는 지난해 말 핵심 기술과 인력을 사들이는 방식으로 추론용 칩 개발사인 그록을 흡수해버렸다. 구글·아마존 등 경쟁사들이 추론에 특화된 자체 AI 칩을 개발한 상황에서 추론용 칩은 반전 카드가 될 수 있다.

현재 엔비디아가 장악하고 있는 그래픽처리장치(GPU)는 방대한 양의 데이터를 동시에 학습하는 병렬 처리에 적합한 반면 빠르게 순차적으로 명령을 처리해야 하는 추론 개발 시장에서는 약점이 있다. LPU는 초당 수천 개 토큰(AI가 질문·답변을 처리하는 단위)을 처리할 만큼 속도가 빠르고 칩 비용도 GPU 대비 저렴하지만 이같은 성능을 구현하려면 많은 칩이 필요하다. 엔비디아는 GPU와 LPU를 모두 장악해 에이전틱 AI 시대에도 선두 주자 자리를 지키겠다는 구상이다.

엔비디아 최신 GPU 루빈이 288기가바이트(GB)의 HBM4 메모리를 탑재한 반면 LPU는 메모리 용량이 500분의 1 수준인 500메가바이트(MB) 규모 S램을 쓴다. 대역폭은 루빈이 초당 22테라바이트(TB)인 반면 그록 3 LPU는 150TB로 크다. LPU를 여러개 결합하면 대역폭은 훨씬 늘어나 속도는 더 빨라진다.

삼성전자는 최신 HBM인 HBM4 양산에 세계 최초로 성공하면서 베라 루빈 HBM 공급 경쟁에서 우위를 점하고 있다. 엔비디아가 AI 추론 시장으로 영향력을 확대하기 위해 개발한 LPU 생산을 삼성전자에 맡기면서 삼성전자는 엔비디아와 더 밀착할 수 있게 됐다는 평가다.

실리콘밸리=김창영 특파원 kcy@sedaily.com

[ⓒ 서울경제, 무단 전재 및 재배포 금지]